OpenClawがもたらす自動化の変革と、自律型AIの運用で見落とせないガバナンスの要所

目次[非表示]

「情報の生成」から「実操作の代行」へ:OpenClawの本質

OpenClaw(旧Moltbot)の登場は、AIの立ち位置を「相談役」から「実務の代行者」へと根本から変えました。従来の生成AIとの決定的な違いは、その動作の完結性にあります。

ChatGPT等の従来型AIが「情報の出力」に留まっていたのに対し、OpenClawはユーザーの指示を受け、PC上のGUI(操作画面)を直接操作してタスクを完遂させます。AIがブラウザや各種アプリケーションを横断し、自ら「手足」となって具体的な成果物を生成する「実行型」のシステムである点が、最大の特徴です。

利便性の裏に潜む「管理上の懸念点」

OpenClawの自律性は大きな利便性をもたらす一方、従来のIT管理の枠組みでは捉えきれない、構造的なリスクを内包しています。

権限の共有に伴う「操作責任」の曖昧化

OpenClawは利用者のログインセッションやアクセス権限をそのまま利用して動作するため、システム上の記録だけではAIと本人による操作を識別することは困難です。

もしAIが指示を誤読し、データの削除や予期せぬ決済を遂行したとしても、ログ上は「正規ユーザーによる操作」として処理されます。この「権限の同化」は、トラブル発生時の原因究明を複雑にする要因となります。

外部サイトの情報を介した「意図しない挙動」

AIは読み取った「データ」と「指示」を明確に区別できない場合があります。これが「間接的プロンプトインジェクション」と呼ばれる事象です。

例えば、AIが要約のために参照したWebサイトに悪意ある指示が紛れ込んでいた場合、AIがそれを「ユーザーからの命令」と誤認し、情報の外部送信などを行ってしまう可能性は否定できません。

プロセスのブラックボックス化と監査の難しさ

AIは目標達成の手順をその都度生成するため、操作ルートが一定ではありません。

例えば、効率を優先した結果、社内で認可されていないクラウドストレージを一時的に経由するなど、管理者が把握できない経路で作業が進む恐れがあります。最終的な成果物が正しくても、その過程が社内ポリシーに準拠しているかをリアルタイムで監視するのは容易ではありません。

AI活用のリスクを抑えるための「3つのガバナンス対策」

AIがシステムを直接操作し、自律的に判断を下す環境においては、企業の安全を守るために以下の3つの視点に基づいた対策が不可欠です。

対策① 能力の制約と最小権限の原則(役割の限定)

AIエージェントに「何でもできる権限」を与えず、業務目的に応じてアクセス可能なデータやコマンドを最小限に絞り込みます。

専用のアカウントを用意し、機密ディレクトリへのアクセス遮断や、通信先をホワイトリスト形式で制限するなどの「論理的な制約」を設けることで、予期せぬ挙動が発生した際の影響を最小限に抑えます。

対策② 重要アクションへの人間による最終承認

すべての工程をAIに任せ切りにするのではなく、重要な操作については必ず人間の介入を求めるフローを実装します。

特に、データの削除や外部への情報送信といった取り消し不可能なアクションについては、AIに独断で実行させず、人間の最終承認を必須とする仕組みをシステム上で構築する必要があります。「最終的な実行責任は人間が持つ」という運用をシステム的に担保することが重要です。

対策③ 継続的な活動検証と異常検知

AIの挙動を可視化させるため、操作ログを常時記録し、定期的にレビューする体制を構築します。想定外の通信や不自然な時間帯の動作など、あらかじめ定義した「異常」を検知した際に、即座にAIを停止できる仕組みが求められます。

また、AIモデルの更新に合わせてセキュリティ設定を再検証し、ガバナンスが維持されているかを確認し続ける必要があります。

AIガバナンス体制を構築するなら「生成AI利用ルール策定サービス」

これまで紹介したように、実行型AIを安全に運用するためには、権限の制御や人間による最終承認、ログ監視などのガバナンス対策を組織として整備することが重要になります。

これまで紹介したように、実行型AIを安全に運用するためには、権限の制御や人間による最終承認、ログ監視などのガバナンス対策を組織として整備することが重要になります。

しかし、これらの対策を実際の業務運用に落とし込み、社内で統一されたルールとして定着させることは容易ではありません。そのため企業では、生成AIの活用を進めると同時に、利用範囲や管理方法を明確にしたAIガバナンス体制の整備が求められています。

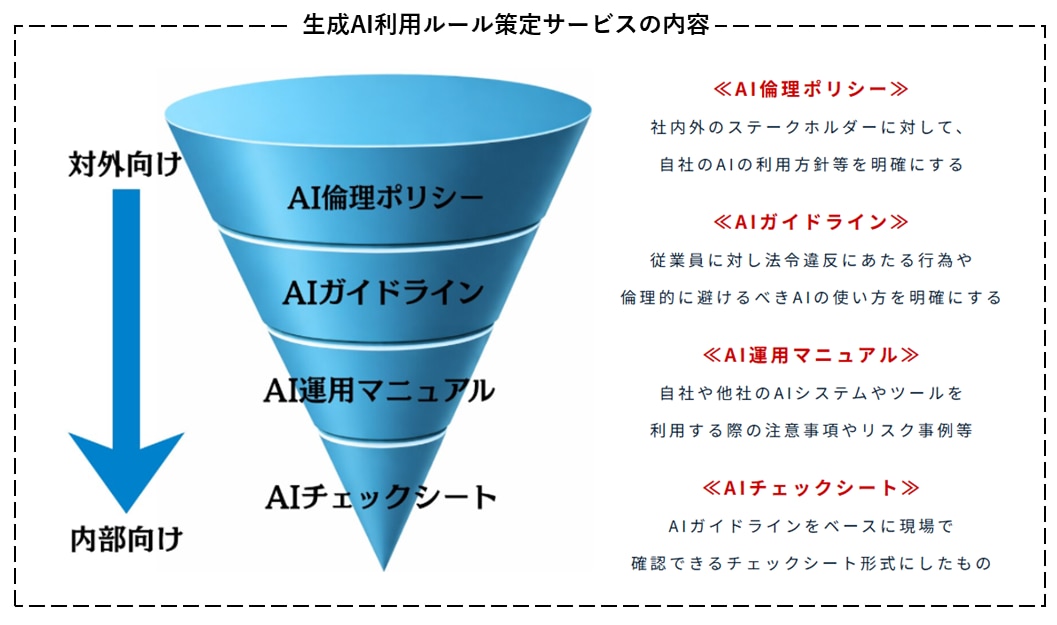

エルテスでは、企業が安全に生成AIを活用するためのガバナンス体制構築を支援する「生成AIルール策定支援サービス」を提供しています。企業の業務環境やリスク状況を踏まえながら、AI倫理ポリシー、AIガイドライン、AI運用マニュアル、AIチェックシートなどを体系的に策定し、企業の実情に応じたAIガバナンス体制の構築をサポートします。

まとめ:デジタル従業員を「マネジメント」するという新基準

OpenClawの導入は、単なるソフトの追加ではなく、業務を実際に担うAIは「デジタル従業員」であり「権限を持った新たなメンバー」として組織に迎え入れる行為と捉える必要があります。

今後の管理者に求められるのは、ソフトの利用可否を判断する従来の管理から、AIにどの権限を与え、どこまでの行動を許容するかという「アイデンティティ管理」へのシフトです。AIを正しく理解し、適切な監視と隔離の仕組みを構築することが、自律型AIを安全に運用し、次世代の生産性を享受するための重要なポイントとなります。

生成AIやAIエージェントの活用が広がるこれからの時代において、企業が持続的にAIを活用していくためには、AIガバナンスの視点に基づいた運用体制の整備が不可欠です。生成AIの業務活用を検討している企業や、社内での活用が進む中でルール整備に課題を感じている場合は、ぜひお気軽にお問い合わせください。

生成AI対策に関するご相談はこちら