生成AIリスクとは?企業が知るべき危険性と安全対策ガイド

業務効率化や生産性向上の手段として急速に普及している生成AIですが、従業員が生成AIに機密情報を入力して情報漏洩につながった事例や、AI生成コンテンツが著作権問題に発展したケースが増加しています。

さらに近年では、生成AIを悪用したサイバー攻撃の高度化も進んでおり、企業が対策を講じないまま生成AIを活用することは大きなリスクを伴います。

このコラムでは、生成AIに潜む具体的な危険性を整理し、企業が生成AIを安全に活用するための実践的な対策を解説します。

目次[非表示]

生成AIとは

生成AI(生成系AI/ジェネレーティブAI)とは、大量の学習データをもとに新たなコンテンツを自動的に生成するAI技術を指し、従来のAIが分類や予測を主な役割としていたのに対し、生成AIは文章や画像、音声、動画などを生成できる点に特徴があります。

具体的には文章の作成から画像の生成、さらには音楽制作から動画生成に至るまで多様な形式のコンテンツを生成することが可能であり、自然な会話ができるチャットAIやデザイン・プログラミングを支援するツールなど実務に直結する活用が急速に広がっています。

専門知識がなくても簡単な指示(プロンプト)を入力するだけで高品質な成果物を短時間で得られるため、業務効率化やコスト削減、新たなアイデア創出の手段として多くの企業で導入が進んでいます。

さらに近年では、単にコンテンツを生成するだけでなく、目的に応じてタスクを自律的に分解し、情報収集から分析、資料作成まで複数の処理を連携させながら一貫して実行するAIエージェントも登場しています。生成AIは単なるツールにとどまらず、業務プロセスそのものを変革する技術として重要性が高まっています。

日常業務に潜む生成AIの3大リスクと実際のトラブル事例

企業活動において生成AIを対策なしで利用した場合、主に以下の3つのリスクが想定されます。

情報セキュリティのリスク

生成AIの利用において最も重大なリスクは、機密情報の外部送信です。

例えば、従業員が業務効率化のために顧客情報や社内資料をプロンプトとして入力した場合、情報が外部のサーバーに送信され、意図せず第三者に利用される可能性があります。特にパブリックな生成AIサービスでは、入力データがモデルの改善や再学習に利用されるケースもあり、企業情報が管理できない形で外部に残るリスクがあります。

また、社内で利用状況が把握されていない「シャドーAI」の存在も問題です。IT部門の管理外で個別に利用が進むと、どのような情報が入力されているか把握できず、インシデント発生時の対応も遅れる可能性があります。

さらに、生成AIサービスを狙った不正アクセスや、認証情報の漏洩によるアカウント乗っ取りなど、従来のITサービスと同様のセキュリティリスクも考慮する必要があります。

▶【実態調査】生成AI利用者の約5人に1人が「シャドーAI」リスク

コンプライアンス・法的リスク

生成AIは学習データをもとにコンテンツを生成するため、既存の著作物と類似した表現が出力される可能性があります。生成された文章や画像をそのまま商用利用した場合、著作権侵害と判断されるリスクがあります。

特に広告や広報など外部発信に関わる業務では、意図せず他者の権利を侵害する可能性があり、企業としての責任が問われる場面も想定されます。

また、生成AIが不適切または差別的な表現を含むコンテンツを生成した場合、ブランドイメージの毀損や炎上リスクにつながる可能性があります。生成AIの出力内容は常に適切性を確認する必要があります。

▶【関連記事】画像生成AIを利用するときの注意点とは?トラブル事例や解決策も紹介

業務品質のリスク(ハルシネーション)

生成AIは、ハルシネーション(AIが事実と異なる情報を生成する現象)を引き起こす特性を持っています。もっともらしい文章で誤情報を生成するため、内容を確認せずに利用すると、誤った情報を意思決定や顧客対応に使用してしまうリスクがあります。

例えば、誤った法令情報や不正確な数値データを資料に含めてしまうと、意思決定の誤りや対外的な信用低下につながります。ハルシネーションは完全に防ぐことが難しいため、生成AIの出力は必ず人間が確認する前提で運用する必要があり、特に重要な情報については、複数の情報源で裏付けを取る運用が求められます。

生成AIリスクを最小化するために組織全体で実践すべき安全対策

生成AIのリスクを個人の判断に委ねるのではなく、組織全体を巻き込んだ包括的な対策として最小化するために、企業は以下3つの対策を組み合わせて実施する必要があります。

対策1:利用ガイドラインの策定

生成AIの利用ガイドラインは、抽象的な方針ではなく、実務での利用シーンを想定した内容に落とし込む必要があります。

① 使用可能なAIツールの指定

社内セキュリティ基準を満たしたAIツールのみを利用可能とし、無許可の外部サービスの利用を制限します。特に個人契約での利用(シャドーAI)を防ぐため、利用可能なツールを明示することが重要です。

② 入力禁止情報の定義

個人情報、顧客情報、未公開の営業情報、ソースコード、設計情報など、外部送信が許されない情報を具体的に定義します。判断に迷いやすいケースについては、具体例を併記することで現場での判断精度を高めることができます。

③ 出力内容の確認ルールの策定

生成AIの回答には誤情報が含まれる可能性があるため、利用前に必ず人間が確認する運用を定めます。確認項目として、事実関係の正確性、著作権上の問題、不適切表現の有無などを明確にしておくことが重要です。

④ インシデント対応フローの構築

機密情報の誤入力や不適切な利用が発生した場合に備え、報告ルートと対応手順を明確にします。誰がどのタイミングで報告し、どの部門が対応するのかを定義することで、初動対応の遅れを防ぐことができます。

対策2:従業員教育の徹底

生成AIの適切な利用には、従業員がリスクの仕組みを理解していることが前提となります。単なる注意喚起ではなく、実務に即した教育を行うことが重要です。

① AIリテラシー研修の実施

生成AIの仕組みやハルシネーションの特性、著作権リスク、不適切な出力の可能性などを体系的に理解させます。

② セキュリティ教育の実施

情報漏洩が発生する典型的な利用パターンを示し、どの情報を入力してはいけないかを具体的に教育します。業務シーンに即したケーススタディを用いることで、現場での判断力を高めることができます。

③ 教育内容の定期的なアップデート

生成AIの機能やリスクは短期間で変化するため、教育内容を継続的に見直し、最新のリスク情報や利用ルールを反映させる必要があります。

対策3:安全なツール選定

生成AIツールの選定においては、機能面だけでなくデータ管理と運用管理の観点が重要であり、企業利用を前提とした統制が可能なツールを選定する必要があります。

① 信頼できる提供元の確認

法人向けのセキュリティ基準を満たし、契約上の責任範囲が明確な事業者を選定します。データの取り扱いやサポート体制についても事前に確認することが重要です。

② 学習利用のオプトアウト機能の活用

入力したプロンプトや社内データがモデルの再学習に利用されない設定が可能かを確認し、情報の外部利用リスクを低減します。

③ MFA(多要素認証)の導入

IDとパスワードのみの認証では不正アクセスのリスクが高いため、多要素認証を導入します。あわせて、SAML認証によるシングルサインオン(SSO)と連携し、アカウント管理を統制することが望ましいといえます。

④ 利用状況の可視化とログ管理

誰がどのツールをどのように利用しているかを把握できる仕組みを整備し、利用ログの取得や管理機能を活用することで、不適切な利用の早期発見と是正が可能になります。

▶【関連記事】「シャドーAI」とは?見えないAI利用が招く情報漏洩リスクと企業が今すぐ実施すべき対策

生成AIリスクを管理するチェックリスト

生成AIのリスクは、気づかないうちに日常業務の中で蓄積されていく点に特徴があります。まずは現状の運用体制を確認し、リスクの有無を把握することが重要です。

以下の項目に1つでも該当する場合は、自社のセキュリティやコンプライアンスにおけるリスクが高い状態であり、早急な対策が必要です。

- 詳細なガイドラインが存在しない

- 全社的な従業員教育が未実施である

- 業務で利用するAIツールが統制されていない

- 出力結果に対する厳密なチェック体制がない

- 社内での利用責任者が不明確である

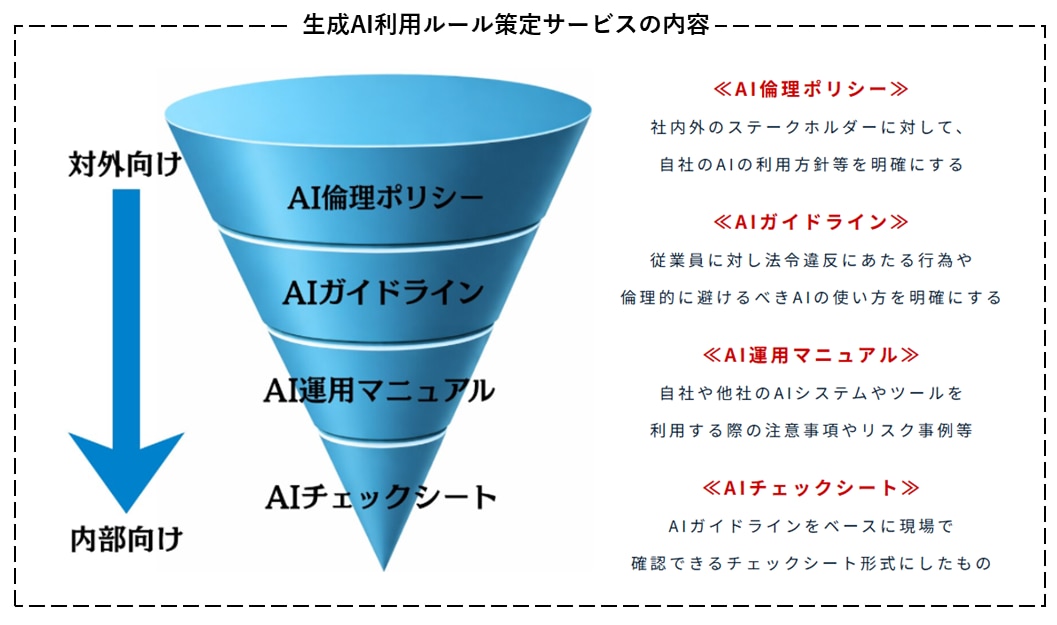

AIガバナンスの運用体制を確保するなら「生成AIルール策定支援サービス」

生成AIリスクを適切に管理するためには、属人的な判断に依存しない運用体制の整備が重要です。エルテスの「生成AIルール策定支援サービス」は、企業ごとの利用状況を踏まえ、AI倫理ポリシーやガイドライン、運用マニュアル、チェックシートなどの文書を整理し、生成AIの利用に関する判断基準を明確にする支援を行います。

生成AIリスクを適切に管理するためには、属人的な判断に依存しない運用体制の整備が重要です。エルテスの「生成AIルール策定支援サービス」は、企業ごとの利用状況を踏まえ、AI倫理ポリシーやガイドライン、運用マニュアル、チェックシートなどの文書を整理し、生成AIの利用に関する判断基準を明確にする支援を行います。

まとめ

生成AIは業務効率化を加速させる一方で、情報漏洩や著作権侵害、誤情報の拡散といったリスクも併せ持つ技術です。生成AIリスクを防ぐには、個人任せではなく、組織としてルールと運用体制を整備することが不可欠です。

今後、生成AIの活用はさらに広がり、対策の有無が企業の競争力にも直結します。まずは自社の利用状況とリスクを正しく把握し、適切なガバナンス体制を構築することが重要です。対策に不安がある場合は、ぜひお気軽にエルテスへご相談ください。

生成AI対策に関するご相談はこちら